澳大利亚加强AI监管:ChatGPT的更强防护栏

澳大利亚政府计划根据公众关注,对人工智能(AI)系统实施更严格的监管规定

澳大利亚正在考虑对被视为“高风险”的人工智能进行监管,引发了人们的焦虑。

发布日期:2024年1月17日 😎

📷 图片:澳大利亚考虑人工智能监管的概念。澳大利亚地图的象征性表示,其中有连通的电线通过。

澳大利亚政府正在为人工智能系统的崛起做好准备,特别是像ChatGPT这样的系统,通过实施更严格的监管措施。公众的担忧促使工业和科学部长埃德·休西奇发布政府对人工智能安全和责任咨询的临时回应。尽管人工智能有潜力每年推动澳大利亚国内生产总值增长6000亿美元,但调查显示,只有三分之一的人口认为目前有足够的保障措施。看来澳洲是对采用这项技术最为忧虑的国家,令人震惊的是,69%的澳大利亚人表示他们很担心。

💡 但是,澳大利亚将采取哪些措施来应对人工智能的发展呢?

随着咨询的继续进行,工党政府承诺采取以下三个即时步骤:

1. 制定自愿人工智能安全标准 📝

政府计划与行业专家合作,制定人工智能的安全标准。可以将其看作是人工智能的安全带,确保这些系统以更安全和负责任的方式运行。

2. 引入人工智能生成材料的自愿标签和水印 🏷️

为了提高透明度,澳大利亚计划与行业利益相关者合作,制定人工智能生成内容的标签和水印选项。这将有助于区分由人工智能生成的内容和由人类创作的内容。

3. 成立专家咨询组,制定强制性防卫措施 🚧

政府认识到需要更严格的监管措施,计划设立专家咨询小组。该小组的目的是在制定高风险人工智能系统使用的强制性防卫措施方面提供指导和支持。这些防卫措施包括用于评估累犯风险、求职者评估、实现自动驾驶车辆以及像ChatGPT这样快速发展的“前沿人工智能”。

澳大利亚政府重视公众提出的担忧,并力图直面解决。增强透明度仍然是这些建议的关键焦点之一。例如,政府计划在培训人工智能模型,特别是像ChatGPT这样的大型语言模型(LLM)的数据类型方面,实施公开报告。此外,他们将与行业专家合作探索对人工智能生成内容加水印或标记的选择。这是政府在打击有害人工智能材料和在学校规范人工智能使用方面所做努力的补充。

🔒 人工智能是否存在法律上的问题?

确实,有关使用人工智能深度伪造和潜在医疗保健隐私泄露的法律问题已经引起关注。政府目前正在进行评估,以确定训练生成式人工智能模型是否侵犯版权法规定。正如该报告所指出的,内容创作者对像DALL-E 2这样的模型深感不安,该模型未经允许收集图像和文本。

🧠 安全和责任是澳大利亚人工智能战略的核心

休西奇部长强调,确保安全和负责任的人工智能是至关重要的。通过从人工智能设计、开发和部署过程的一开始就解决风险并实施适当的防卫措施,澳大利亚旨在创造一个人工智能可以蓬勃发展的环境。

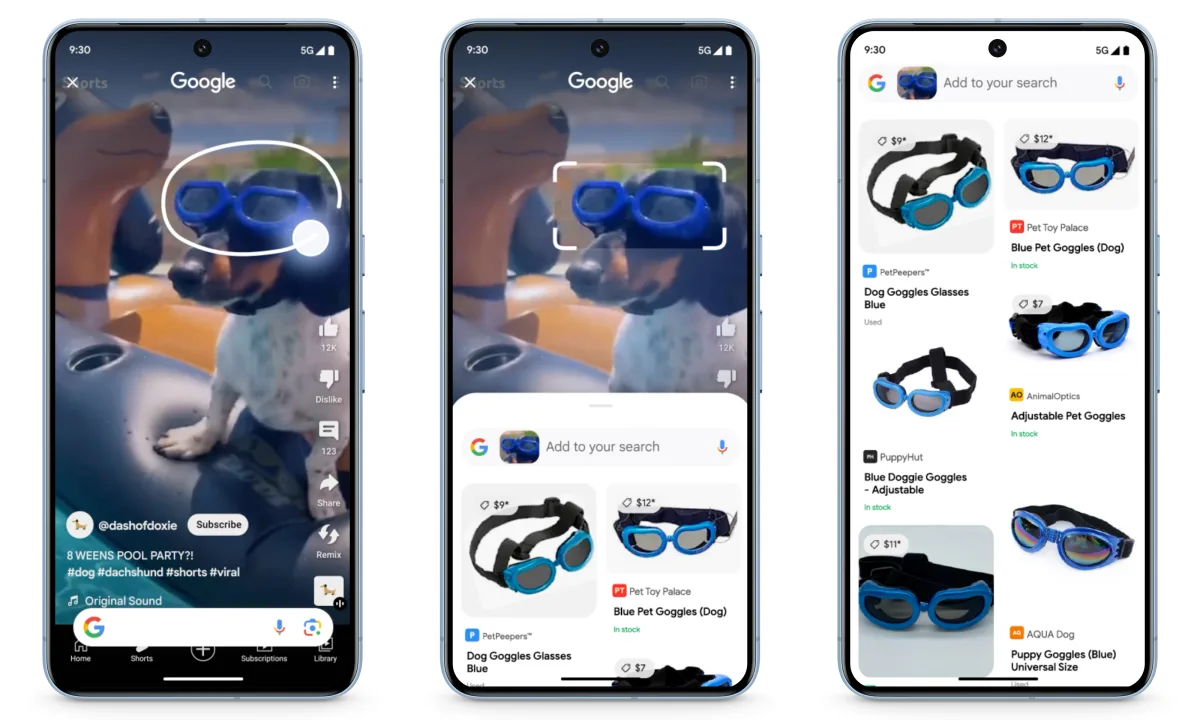

📷 图片:DALL-E

👨💼 关于萨姆·谢登(Sam Shedden),总编辑 萨姆·谢登是经验丰富的新闻记者和编辑,拥有十多年的在线新闻经验。作为经验丰富的技术作家和内容战略师,萨姆为各种出版物做出了贡献,包括《苏格兰人报》、inews.co.uk、nationalworld.com、爱丁堡晚报和《每日记录》。他的专长领域包括媒体、技术、人工智能、初创公司和创新。萨姆在新闻通讯中的工作甚至使他在英国发行商通讯奖的2023年度最佳新闻通讯英雄奖中获得了提名。目前,他担任ENBLE.com的总编辑,负责该网站新闻运营的所有方面。

参考资料: – 敏捷智能:人工智能如何促进技术商业合作 – 大众汽车认为与ChatGPT整合可以使其车载语音助手变得更好 – 政府网站发布杰弗里·爱泼斯坦文件几分钟后崩溃 – Humane宣布解雇10%的员工,首席技术官转任顾问职务 – 索尼的新数字出生证书成像技术“很像NFT” – iOS 17-在新闻应用中玩每日填字游戏 – CBS和Paramount所有者National Amusements称遭到黑客攻击 – AI周报:微软坚持在广告中使用人工智能,键盘

请将以下HTML代码翻译成中文(将HTML代码保留在结果中,并保留标签中src属性的原始信息):

📢 分享您对澳大利亚人工智能监管的想法!您认为它将如何影响未来?在下方发表评论,让我们讨论吧! 🤖💬

关注我们的社交媒体,获取更多有趣的科技内容!