孔启动了为开发人员提供的开源人工智能网关

Kong,一家API公司,今天发布了它的开源AI网关这是他们现有API网关的扩展,使开发人员和运营团队能够...

Kong最新推出的AI Gateway简化了多语言模型应用的创建。

API公司Kong最近推出了其开源AI Gateway,这是其现有API网关的扩展,允许开发人员和运维团队通过单一API将其应用程序与大型语言模型(LLMs)集成并访问它们。这是对各行业和组织对人工智能能力的不断增长的需求的回应。

“API是基于使用案例的推动因素:移动,微服务-人工智能只是最新的一个案例。当我们看着人工智能时,我们实际上是在遍布整个API。我们正在研究在消费人工智能时的API,我们正在研究在微调API和AI自身时的API。因此,人工智能越多,我们在世界上使用API的次数就越多。” Kong的联合创始人兼首席技术官Marco Palladino解释说。

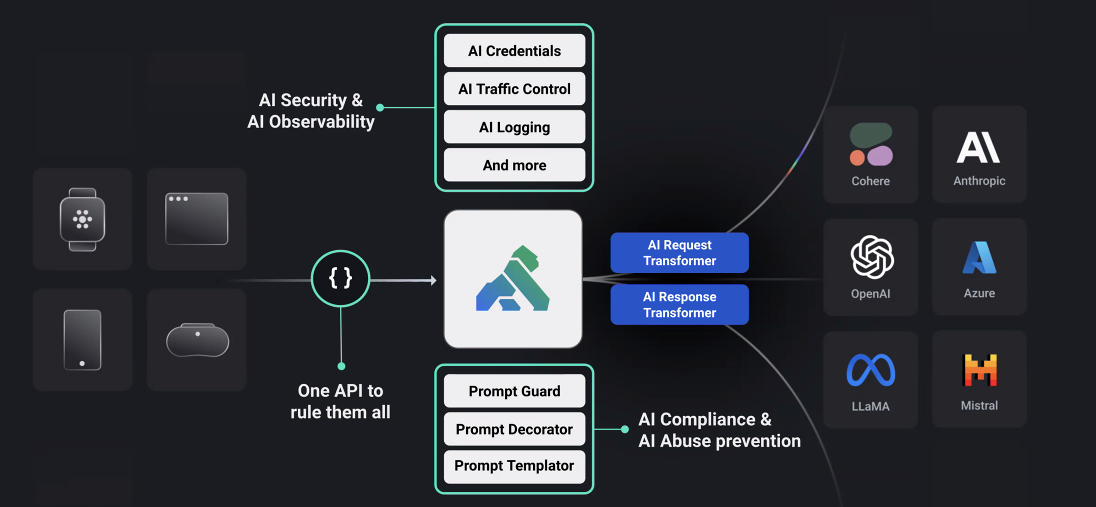

组织使用人工智能面临的一个主要问题是数据的潜在泄漏。Kong通过将其网关扩展为允许公司在本地运行其AI模型,并提供云作为备用选项来解决此问题。为了有效管理这些AI模型,公司还需要处理凭据、流量控制、日志记录和配额管理。Kong的API网关提供了一种解决方案,使开发人员能够在不修改现有代码的情况下使用多个LLM提供商。

AI Gateway目前支持Anthropic、Azure、Cohere、Meta’s LLaMA模型、Mistral和OpenAI等热门LLM提供商。通过在API的基础上添加额外的AI特定功能,Kong旨在实现新的使用案例并简化现有案例的实现。

🔍问答:

Q: 为什么Kong推出了AI Gateway?A: Kong认识到对人工智能能力的需求不断增长,并希望提供基于API的解决方案,将应用程序与大型语言模型(LLMs)集成。

Q: Kong的AI Gateway有什么优势?A: Kong的AI Gateway允许开发人员使用多个LLM提供商而无需修改现有代码。它还通过允许公司在本地运行其AI模型来解决关于数据泄露的问题。

Q: AI Gateway支持哪些LLM提供商?A: AI Gateway目前支持Anthropic、Azure、Cohere、Meta’s LLaMA模型、Mistral和OpenAI等热门LLM提供商。

提示工程是AI Gateway的一个关键特性,使企业能够在这些模型之上强制执行准则。这集中了准则和提示的管理,提供了一种更有效的方式来确保合规性。

虽然其他API提供商通常将AI API处理为与其他API类似的方式,但Kong的方法专注于使用AI特定功能增强API体验。通过AI响应和请求转换器,开发人员可以对提示和结果进行实时更改,例如自动翻译或删除个人可识别信息。

🌐进一步分析:

Kong推出开源AI Gateway反映了人工智能在各行业中的日益重要性。通过将人工智能能力集成到其现有API网关中,Kong为开发人员提供了更简化和高效的访问和利用语言模型的方式。此外,通过在本地运行AI模型,可以解决数据隐私问题,并使组织对其人工智能基础设施具有更多控制权。

这一举措符合利用API释放人工智能能力的增长趋势。随着人工智能的普及,对于使用、微调和与人工智能交互的API的需求将持续增长。Kong在基于API的人工智能解决方案方面的重视,使其成为这个不断演变的领域的领先者。

💡未来发展:

随着人工智能技术和语言模型的不断发展,Kong的AI Gateway很可能会发展成为支持更多提供商并提供强大的高级功能的解决方案。网关的开源性质使开发者社区可以进一步贡献,促进创新并推动与人工智能整合的可能性的界限。

Kong AI Gateway的推出也引发了对基于人工智能的API未来可能性的猜测。随着人工智能和API技术的融合,我们可以期待在不同领域出现更多创造性和变革性的使用案例,从自然语言处理到计算机视觉等等。

📚参考文献清单:

🙌 互动和分享:

你对 Kong 的新开源 AI Gateway 有什么看法?在社交媒体上分享你的想法并加入讨论!#KongAI #APIGateway #AIIntegration